4сем / ПП_4_сем_pdf / ПП _09 _Многомерные СВ

.pdf

ПП 9. СЛУЧАЙНЫЕ ВЕКТОРЫ ОСНОВНЫЕОПРЕДЕЛЕНИЯИФОРМУЛЫ

1. Многомерные случайные величины

Многомерной случайной величиной или случайным вектором назы-

вается совокупность случайных величин Х(ω)={X1 , X 2 ,..., X n } .

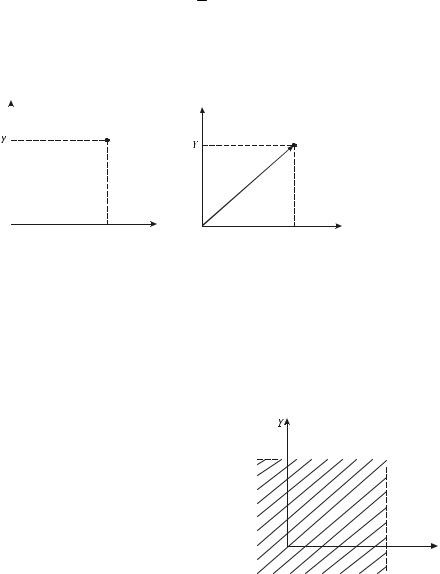

Геометрическая интерпретация двумерной случайной величины - это слу-

JJJJG

чайная точка на плоскости с координатами (X,Y) или случайный вектор OM .

y |

y |

|

|

|

|

(X,Y) |

(X,Y) |

M |

|

|

0 X x 0 X x

2. Функции распределения многомерных дискретных и непрерывных случайных величин

Функцией распределения многомерной случайной величины (совме-

стной функцией распределения одномерных случайных величин)

называется вероятность совместного выполнения n неравенств:

F (x1, x2 ,..., xn ) = P{X1 < x1, X 2 < x2 ,..., X n < xn} .

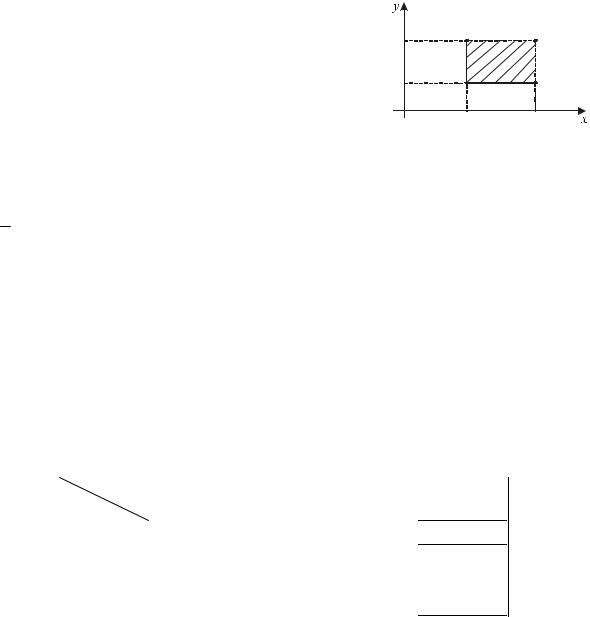

Совместная функция распределения двух случайных величин (X,Y) есть вероятность совместного выполнения двух неравенств

F(x,y)=P{X<x,Y<y}.

Геометрически это означает вероятность попадания случайной точки (X,Y) в заштрихованную область.

y

(x,y)

(x,y)

0 |

x |

X |

|

Основные свойства совместной функции распределения F(x,y): |

1°. Функция F(x,y) не убывает. |

|

2°. |

F (− ∞, y)= F (x,−∞)= F (− ∞,−∞)=0, ( F (− ∞, y)= P({X < −∞}{Y < y}) = 0 ). |

3°. |

F (∞, ∞) =1, F (∞, ∞) = p({X < ∞}{Y < ∞}) =1. |

|

(заштрихованная область заполняет всю плоскость, попадание на нее слу- |

|

чайной точки - событие достоверное). |

4°. |

Если F1 (x), F2 ( y) - функции распределения одномерных случайных величин, |

|

то: F (x, ∞) = F1 (x), F (∞, y) = F2 ( y) , F1 (x) = P{X < x,Y < ∞} = F (x, ∞) (по многомер- |

|

ному распределению можно восстановить одномерное распределение). |

1

5°. Вероятность попадания двумерной случайной величины в пределы заданного прямоугольника со сторонами a1, b1 и

a2 , b2 :

P(a1 ≤ X <b1; a2 ≤Y <b2 ) =

= F(b1,b2 ) −F(a1,b2 ) −F(b1, a2 ) + F(a1, a2 ).

b2 |

(a1, b2 ) |

(b1,b2 ) |

|

|

|

a2 |

(a1, a2 ) |

(b1, a2 ) |

0 |

a1 |

b |

|

|

1 |

Двумерные дискретные случайные величины (ДДСВ)

X ={X ,Y} называется дискретной, если случайные величины X и Y имеют

конечное множество возможных значений: X ={x1, x2 ,..., xk },

Y ={y1, y2 ,..., ys }.

Вероятность того, что случайная величина X примет значение xi, а случайная величина Y – значение yj, называется законом распределения двумерной

Pij = P{X = xi ;Y = y j } .

Событие {X ,Y} есть произведение событий {X = xi }{Y = y j } ;

Рij – совместная вероятность.

Закон распределения ДСВ может быть задан аналогично ряду распределения для одномерной СВ таблицей (или матрицей) распределения:

yi |

y1 |

y2 |

… |

ys |

xi |

|

|

|

p1s |

x1 |

p11 |

p12 |

… |

|

x2 |

p21 |

p22 |

|

p2s |

… |

… |

… |

… |

… |

xk |

pk1 |

pk 2 |

… |

pks |

1) Pij ≥ 0, i, j .

2) ∑Pij =1, |

|

k s |

|

|

|

∑∑= ∑ . |

|||

i, j |

i=1 j=1 |

i, j |

|

|

s |

k |

3) P{X = xi } = ∑Pij (сумма по строке), |

P{Y = y j } = ∑Pij (сумма по столбцу). |

j=1 |

i=1 |

Чтобы найти вероятность того, что одномерная случайная величина примет значение xi(yj) надо просуммировать вероятности Pij, стоящие в i-той строке (j- том столбце) матрицы распределения.

2

Двумерные непрерывные случайные величины (ДНСВ)

X ={X ,Y} называется непрерывной, если ее функция распределения F(x,y) является непрерывной функцией и существует функция f(x,y) – называется (со-

x y

вместная) плотность распределения, F(x, y) = ∫ ∫ f (x, y)dxdy .

−∞ −∞

Свойства функции f (x,y):

1.f (x, y) ≥ 0 ;

2.∞∫ ∞∫ f (x, y)dxdy =1.

−∞−∞

Элемент вероятности равен вероятности попадания случайной точки (X,Y) в элементарный прямоугольник dxdy, а вероятность приблизительно равна объему f(x,y)dxdy.

Вероятность попадания случайной точки (X,Y) в область D плоскости XOY геометрически означает объем тела с основанием D и ограниченного сверху поверхностью f(x,y). P{( X ,Y ) D} = ∫∫ f (x, y)dxdy .

|

D |

Если известен закон распределения НМСВ, то можно найти закон рас- |

|

пределения каждой из величин. |

|

f1 (x) = ∞∫ f (x, y)dy; f2 ( y) = ∞∫ f (x, y)dx . |

|

−∞ |

−∞ |

3. Зависимые и независимые случайные величины

Построим многомерный закон распределения по известным одномерным, когда одномерные случайные величины, составляющие многомерную случайную величину, являются независимыми.

Случайные величины X и Y называются независимыми, если закон распределения каждой из них не зависит от того, какое значение приняла другая.

Случайные величины X и Y независимы тогда и только тогда, когда их

совместная |

функция |

распределения |

равна |

||

произведению |

функций |

распределения |

одномерных |

случайных |

|

величин X и Y : |

F (x, y) = F1 (x) F2 ( y) . |

|

|

|

|

ДСВ X и Y независимы тогда и только тогда, когда |

|

||||

Pij = pi qj ; |

Pij = P{X = xi ;Y = y j }; pi = P{X = xi } ; q j = P{Y = y j } |

|

|||

(каждый элемент Pij матрицы распределения двух независимых с.в.

равен произведению соответствующих (i-того и j-того) элементов рядов распределения с.в. X и Y).

НСВ X и Y независимы тогда и только тогда, когда f (x, y) = f1 (x) f2 ( y) (совместная плотность распределения равна произведению плотностей распределения одномерных с.в.).

4. Условные законы распределения

3

Если СВ X и Y , образующие двумерную ДСВ (X ,Y ), зависимы, для ха-

рактеристики этой зависимости вводят понятие условного распределения:

P (B A)= PP((ABA)).

|

|

Условным законом распределения случайной величины |

X , |

входя- |

||||||||||||||||||||||

щей в систему случайных величин (X ,Y ), называется ее закон распределения, |

||||||||||||||||||||||||||

найденный при условии, что вторая случайная величина Y приняла определен- |

||||||||||||||||||||||||||

ное значение (или попала в определенный интервал). |

|

|

|

|

|

|

|

|

|

|||||||||||||||||

|

|

Рассмотрим |

ДДСВ. |

Пусть |

|

X ={x1 , x2 ,..., xk }, |

Y ={y1 , y2 ,..., ys }, |

|||||||||||||||||||

pij =P(X =xi ;Y = yj ), i =1,2,...,k; j =1,2,...,s. Безусловные вероятности компонент: |

||||||||||||||||||||||||||

|

|

Pxi = P (X = xi )= ∑s |

P (X = xi ;Y = y j )= ∑s |

pij , |

|

|

|

|

|

|

|

|||||||||||||||

|

|

|

|

|

|

j=1 |

|

|

|

|

|

|

|

|

j=1 |

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

k |

|

|

|

|

|

|

|

|

k |

|

|

|

|

|

|

|

|

|

||

|

|

Py j = P(Y = y j )= ∑P(X = xi ;Y = y j )= ∑pij . |

|

|

|

|

|

|

|

|||||||||||||||||

|

|

|

|

|

|

i=1 |

|

|

|

|

|

|

|

|

i=1 |

|

|

|

|

|

|

|

|

|

||

Условная вероятность P(X =xi |

|

Y = yj )= |

P(X = xi ;Y = yj ) |

|

или |

|

|

|||||||||||||||||||

|

|

|

|

|||||||||||||||||||||||

|

|

P(Y = yj ) |

|

|

|

|||||||||||||||||||||

|

|

|

|

|

|

|

|

|||||||||||||||||||

|

|

|

|

|

|

|

|

|

P(xi |

|

yj )= |

pij |

. |

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

P(X =xi ;Y = yj ) |

|

|

Pyj |

|

pij |

|

|

|

|

|

|

|||||||||

|

|

P(Y = yj |

|

X =xi )= |

|

или P(yj |

|

xi )= |

. |

|

|

|

|

|

||||||||||||

|

|

|

|

|

|

|

|

|||||||||||||||||||

|

P(X =x ) |

|

|

|

|

|

|

|

||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

Px |

|

|

|

|

|

|

|

|||||||

|

|

|

|

|

|

|

|

|

i |

|

|

|

|

|

|

i |

|

|

P(xi |

|

|

yj ), |

|

|||

|

|

Если безусловные и условные вероятности |

( Pxi |

|

и |

|

|

Pyj и |

||||||||||||||||||

|

|

|

|

|||||||||||||||||||||||

P(yj |

|

xi )) отличаются, величины X и Y |

|

зависимы, если совпадают – незави- |

||||||||||||||||||||||

|

|

|||||||||||||||||||||||||

симы. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

Для ДНСВ (X ,Y ) |

с плотностью f (x, y ) суммы заменяются интегралами. |

|||||||||||||||||||||||||

Безусловные плотности распределения компонент X и Y равны: f1 (x)= ∫−∞∞ f (x, y )dy , f2 (y )= ∫−∞∞ f (x, y )dx .

Условная плотность распределения (или плотность вероятности

условного распределения) случайной величины |

X при условии, что случай- |

||||||

ная величина Y = y определяется как |

|

|

|

||||

f (x |

|

y )= |

f (x, y ) |

= |

f (x, y) |

|

, f2 (y)≠ 0 . |

|

|||||||

|

|

∞ |

|||||

|

|

|

f2 (y ) |

∫−∞ f (x, y)dx |

|

||

|

|

|

|||||

|

|

|

|

|

|

||

Условная плотность обладает всеми свойствами плотности распределения: f (x y)≥ 0, ∫−∞∞ f (x y)dx =1,

4

f (y |

|

x)= |

f (x, y ) |

= |

f (x, y) |

, f1 (y)≠ 0 . |

|

||||||

|

f1 (x) |

∞ |

||||

|

|

|

|

∫−∞ f (x, y )dy |

|

|

|

|

|

|

|

|

f(x,y)= f1 (x) f (y x)= f2 (y) f (x y).

5.Числовые характеристики двумерной случайной величины

Вдвумерном случае числовые характеристики могут описывать не только среднее значение и степень рассеяния компонент, но и степень зависимости между компонентами.

Математическим ожиданием ДСВ (X ,Y ) называется упорядоченная пара чисел (MX ,MY ).

Для ДДСВ:

|

k |

s |

|

|

k |

s |

|

= yj ). |

|

MX = mx = ∑∑xi pij , MY = my = ∑∑y j pij , pij =P(X = xi ;Y |

|

||||||||

|

i=1 j=1 |

|

|

i=1 j=1 |

|

|

|

||

Для ДНСВ: |

|

|

|

|

|

|

|

||

∞ |

∞ |

(x, y)dxdy , |

∞ ∞ |

|

(x,y)dxdy , |

|

|

|

|

MX = ∫ |

∫ xf |

MY = ∫ ∫ yf |

|

|

|

||||

−∞ −∞ |

|

|

−∞−∞ |

|

|

|

|

|

|

|

f (x, y ) – плотность распределения. |

|

|

|

|||||

Дисперсией ДСВ (X ,Y ) называется упорядоченная пара чисел (DX ,DY ). |

|||||||||

Для ДДСВ: |

|

|

k |

s |

|

|

|

|

|

k |

s |

|

|

|

|

|

|

||

DX = ∑∑(xi −mx |

)2 pij , DY = ∑∑(y j −my )2 pij . |

|

|

|

|||||

i=1 j=1 |

|

|

i=1 j=1 |

|

|

|

|

||

Для ДНСВ: |

|

|

|

|

|

|

|

|

|

∞ |

∞ |

|

|

|

|

∞ ∞ |

|

|

|

DX = ∫ |

∫(x −mx )2 |

f (x, y)dxdy , DY = ∫ ∫(y −my )2 |

f (x,y)dxdy . |

|

|

||||

−∞ −∞ |

|

|

|

|

−∞ −∞ |

|

|

|

|

|

Геометрическая интерпретация этих понятий следующая: математиче- |

||||||||

ское ожидание (mx ,my ) |

– координаты средней точки, относительно которой |

||||||||

разбросаны случайные точки (X ,Y ). По этой причине точка |

(mx ,my ) |

иногда |

|||||||

называется центром рассеяния. |

Дисперсия (DX ,DY ) показывает, насколько |

||||||||

облако точек (X ,Y ) разбросано в направлении осей Ox и Oy . |

|

|

|||||||

|

Начальный момент порядка k+s двумерной случайной величины |

||||||||

(X ,Y ): |

αk ,s = M (X kY s ). |

|

|

|

|

(X ,Y ): |

|||

Центральный |

момент |

порядка |

k+s |

ДСВ |

|||||

µk ,s = M ((X −mx )k (Y −my )s ). |

|

|

|

|

|||||

5

В соответствии с этим определением:

mx = M (X 1Y 0 )=α1,0 , my = M (X 0Y 1 )=α0,1 ; DX = M ((X −mx )2 (Y −my )0 )= µ2,0 , DY = M ((X −mx )0 (Y −my )2 )= µ0,2 .

6. Корреляционный момент и коэффициент корреляции Корреляционный момент с.в. (X ,Y ) (момент связи, ковариация) –

смешанный центральный момент второго порядка:

KXY = cov (X ,Y ) = µ1,1 = M ((X − mx )(Y −my )).

Для ДДСВ :

k |

s |

KXY = ∑∑(xi −mx )(y j −my )pij . |

|

i=1 j=1 |

|

Для ДНСВ: |

|

∞ |

∞ |

KXY = ∫ |

∫(x −mx )(y −my )f (x, y)dxdy . |

−∞ −∞

Для вычисления ковариации удобно использовать формулу

KXY = cov (X ,Y ) = M (XY )− MX MY .

Свойства ковариации:

1°. Ковариация симметрична: KXY = KYX .

2°. Постоянный множитель можно выносить за знак ковариации: cov (cX ,Y ) = c cov (X ,Y ) = cov (X ,cY ).

3°. Ковариация не изменится, если к случайным величинам добавить постоян-

ные: cov (X +a,Y ) = cov (X ,Y +b) = cov (X +a,Y +b) = cov (X ,Y ). 4°. Дисперсия СВ есть ее ковариация с самой собой, DX = KXX .

5°. Дисперсия суммы (разности) двух СВ равна сумме их дисперсий плюс (минус) их удвоенная ковариация:

D (X ±Y ) = DX + DY ±2KXY . 6°. Если СВ X и Y независимы, то KXY = 0 .

7°. Ковариация двух СВ по абсолютной величине не превосходит произведения их средних квадратических отклонений,

KXY ≤σx σy .

Если KXY ≠ 0 , то СВ X и Y зависимы, если KXY ≠ 0 , СВ X и Y называют коррелированными. Однако из условия KXY = 0 не следует независимость

СВ X и Y . Если KXY = 0 , СВ X и Y называют некоррелированными. Из не-

зависимости следует некоррелированность, обратное утверждение неверно, из некоррелированности независимость не следует.

6

Из определения ковариации видно, что она описывает и степень рассеяния СВ X и Y , и связь между этими величинами. Для того, чтобы исключить влияние рассеяния и оценить только степень зависимости, обычно переходят к

стандартным СВ: |

|

|

|

X −m |

x |

|

и |

Y −my |

. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||||

|

|

|

|

|

σx |

|

|

|

|

σy |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||

|

|

|

|

|

|

Коэффициентом корреляции СВ X и Y |

называется ковариация |

|||||||||||||||||||||||||||||||||||||

соответствующих им стандартных с.в.: |

|

|

|

cov (X ,Y ) |

|

|

|

|

|

|

|

|

|

|||||||||||||||||||||||||||||||

|

|

|

|

|

|

|

|

r |

|

|

= cov |

|

X |

|

−m |

x |

, |

Y −my |

|

|

K |

XY |

. |

|

|

|

|

|

||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

= |

|

= |

|

|

|

|

|

|

|||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

σ |

|

|

|

σ |

|

|

|

σ σ |

|

|

|

|

|

|

|

|||||||||||||||||

|

|

|

|

|

|

|

|

XY |

|

|

|

|

|

|

|

x |

|

|

y |

|

|

σ σ |

|

|

|

|

|

|||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

x y |

|

x |

y |

|

|

|

|

|

|||||||||||

Свойства коэффициента корреляции |

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||||||||||||||||

1°. |

|

rXY |

|

≤1. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

2°. |

Для независимых СВ rXY = 0 . |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||||||||||||||||||||||

3°. |

Если СВ X |

|

|

и Y |

|

|

связаны |

линейной функциональной |

зависимостью, |

|||||||||||||||||||||||||||||||||||

|

Y = aX +b, a ≠ 0 , то |

|

rXY |

|

=1, причем rXY |

=1 при a > 0 и rXY |

= −1 при a < 0 . |

|||||||||||||||||||||||||||||||||||||

|

|

|

||||||||||||||||||||||||||||||||||||||||||

4°. |

Если |

|

rXY |

|

=1, то с.в. |

|

|

X и Y связаны линейной функциональной зависимо- |

||||||||||||||||||||||||||||||||||||

|

|

|

|

|||||||||||||||||||||||||||||||||||||||||

|

стью. |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

|

Коэффициент корреляции rXY |

является мерой линейной связи между СВ: |

||||||||||||||||||||||||||||||||||||||||||

|

если rXY |

= 0 , СВ независимы, |

если |

|

|

rXY |

|

|

=1, СВ связаны линейной зависи- |

|||||||||||||||||||||||||||||||||||

|

|

|

||||||||||||||||||||||||||||||||||||||||||

|

мостью, |

при |

|

rXY |

|

≠1 зависимость носит иной характер. Чем больше |

|

rXY |

|

, |

||||||||||||||||||||||||||||||||||

|

|

|

|

|

||||||||||||||||||||||||||||||||||||||||

|

тем больше связь между X и Y похожа на линейную. |

|

|

|

|

|

|

|

||||||||||||||||||||||||||||||||||||

|

При rXY |

> 0 говорят о положительной корреляции между X и Y , при |

||||||||||||||||||||||||||||||||||||||||||

|

rXY < 0 – об отрицательной корреляции. |

|

|

|

|

|

|

|

|

|

||||||||||||||||||||||||||||||||||

|

7. |

Числовые характеристики условных распределений |

||||||||||||||||||||||||||||||||||||||||||

|

|

Условное математическим ожидание СВ X при Y = y , |

|

|

|

|

|

|||||||||||||||||||||||||||||||||||||

где y – одно из возможных значений СВ Y , называется: |

|

|

|

|

|

|

|

|

||||||||||||||||||||||||||||||||||||

для ДСВ

k

M (X Y = y )= ∑xi p (xi y) -

i=1

- сумма произведений значений СВ X на их условные вероятности; для НСВ

∞

M (X Y = y)= ∫ xf (x y)dx ,

−∞

где f (x y) – условная плотность распределения.

Условное математическое ожидание M (X y) является функцией y ,

7

M (X y)=ϕ (y),

которую называют функцией регрессии X на Y .

Аналогично определяется условное математическое ожидание M (Y x) и функция регрессии Y на X , M (Y x)=ψ (x).

8. Линейная регрессия. Прямые линии среднеквадратической регрессии

Для ДСВ (X ,Y ), где X и Y – зависимые СВ приближенно представим

одну из величин как функцию другой. Ограничимся простейшим случаем линейной зависимости:

Y g (X )=αX + β ,

где α и β – параметры, подлежащие определению.

Среднеквадратическая регрессия Y на X - функция

g (X )=αX + β = r |

σy |

X +my −r |

σy |

mx = my + r |

σy |

(X −mx ), |

|||||||||||||

|

|

|

|||||||||||||||||

|

|

|

|

|

|

σ |

x |

|

σ |

x |

|

σ |

x |

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

||||||||

где M (X )= mx , M (Y )= my , σx = |

D (X ) |

, σy = |

D (Y ), r = |

µxy |

– коэффици- |

||||||||||||||

|

|||||||||||||||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

σxσy |

|||

ент корреляции величин X и Y , |

называется наилучшим приближением Y в |

||||||||||||||||||

методе наименьших квадратов (МНК). |

|

|

|

|

|

|

|

|

|

||||||||||

Коэффициент |

α = r |

σy |

называется коэффициентом регрессии Y на X , а |

||||||||||||||||

|

|||||||||||||||||||

|

σy |

|

σx |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

прямая y = my + r |

(x −mx ) |

– прямой среднеквадратической регрессии Y |

|||||||||||||||||

|

|||||||||||||||||||

|

σ |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

на X . |

x |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||||

|

|

|

|

F (α,β)min =σy2 (1−r2 ), достигающееся при таких |

|||||||||||||||

Минимальное значение |

|||||||||||||||||||

α и β , называется остаточной дисперсией случайной величины Y относи-

тельно случайной величины X ; она описывает величину ошибки, возникающей при замене Y линейной функцией g (X )=αX + β . Если r = ±1, остаточ-

ная дисперсия равна нулю, так как в этом случае X и Y связаны строгой, а не приближенной линейной функциональной зависимостью.

Аналогично построенной функции среднеквадратической регрессии Y на X можно построить среднеквадратическую регрессию X на Y :

h (Y )= mx + r σx (Y −my ),

σy

8

для которой r |

σx |

– коэффициент регрессии |

X на Y , x = mx + r |

σx |

(y −my ) – |

||

|

σ |

y |

|

|

σ |

y |

|

|

|

|

|

|

|

||

прямая среднеквадратической регрессии X на Y , σx2 (1−r2 ) – остаточная

дисперсия величины X относительно величины Y .

Из уравнений прямых среднеквадратической регрессии видно, что они обе проходят через центр рассеяния – точку с координатами (mx ,my ). Если r = ±1, то обе прямые регрессии совпадают.

9. Линейная корреляция. Двумерный нормальный закон распределения

Рассмотрим двумерную СВ (X ,Y ). |

Если и функция регрессии X на Y |

||||

M (X |

|

y)=ϕ (y), и функция регрессии Y |

на X M (Y |

|

x)=ψ (x) оказываются |

|

|

||||

линейными, то говорят, что X и Y связаны линейной корреляционной зави- |

|||||

симостью. Графики функций регрессии в этом случае оказываются прямыми среднеквадратической регрессии.

Это имеет место в одном важном частном случае – если двумерная СВ

распределена по двумерному нормальному закону:

|

|

|

|

|

1 |

|

|

(x−ax ) |

2 |

(y−ay ) |

2 |

|

|

|

|

|

1 |

|

|

− |

|

|

+ |

−2rxy |

x−ax y−ay |

||||||

|

|

|

|

2 |

|

2 |

2 |

σx |

|

σy |

|

||||

f (x, y)= |

|

e |

|

2(1−rxy ) |

σx |

|

σy |

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

. |

||

2πσ σ |

|

|

|

|

|

|

|

|

|

|

|

||||

|

1−r2 |

|

|

|

|

|

|

|

|

|

|

|

|

||

|

x y |

xy |

|

|

|

|

|

|

|

|

|

|

|

|

|

Нормальный закон на плоскости определяется пятью параметрами: ax , ay - математические ожидания, σx , σy – среднеквадратические отклонения, rxy – ко-

эффициент корреляции величин X и Y . Для двумерного нормального распределения связь между некоррелированностью и независимостью компонент X и Y становится взаимно однозначной: если компоненты независимы, они некор-

релированы, если они |

некоррелированы, |

то они независимы. (Если |

f (x,y)= f1 (x) f2 (y), то rxy |

= 0 , если rxy = 0 , то |

f (x,y)= f1 (x) f2 (y)). |

Для двумерного нормального распределения между компонентами существует линейная корреляционная зависимость.

ПП 9. Законы распределения и числовые характеристики ДСВ и НСВ

№ п/п |

Задание |

Ответ |

ПП |

Двумерная случайная величина (X ,Y ) задана таблицей: |

|

9.№1. |

|

|

|

|

|

9

|

yi |

xj |

1 |

3 |

5 |

|

|

|

|

||||

|

|

|

|

|

|

|

|

1 |

|

0,01 |

|

0,03 |

|

|

2 |

|

0,15 |

|

0,12 |

|

|

4 |

|

|

0,25 |

|

|

|

5 |

|

|

0,3 |

0,14 |

|

Найдите

1)законы распределения случайных величин X и Y и их числовые характеристики;

2)составьте условные законы распределения составляющих случайных величин и вычислите соответствующие математические ожидания;

3)вычислите корреляционный момент (коэффициент ковариации) и коэффициент корреляции;

4)постройте поле распределения и линии регрессии

Y по X и X по Y.

РЕШЕНИЕ:

1) Сумма по столбцам

|

|

xi |

|

1 |

|

3 |

|

|

5 |

|

|

|||

|

|

p |

|

0,16 |

0,55 |

0,29 |

|

|||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Сумма по строкам: |

|

|

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|||||

|

yi |

|

1 |

|

2 |

|

4 |

|

5 |

|||||

|

p |

|

0,04 |

|

0,27 |

|

0,25 |

|

0,44 |

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

2) M (X )=1 0,16 +3 0,55 +5 0,29 = 0,16 +1,45 +1,65 = 3,26 ,

M (Y )=1 0,04 + 2 0,27 + 4 0,25 +5 0,44 = 2,2 +1+0,04 +0,54 = 3,78 ,

M (X 2 )=1 0,16 +9 0,55 +25 0,29 = 0,16 +7,25 +4,95 =12,36 ,

M (Y 2 )=1 0,04 + 4 0,27 +16 0,25 + 25 0,44 =16,12 ,

D(X )= M (X 2 )−(M (X ))2 =12,36 −10,62 =1,732 , D(Y )= M (Y 2 )−(M (Y ))2 =16,12 −14,288 =1,832 .

P(x1 |

|

у1 )= |

p(x1 ,y1 ) |

= |

0,01 |

=0,25, |

|

||||||

|

p(y ) |

0,04 |

||||

|

|

|

|

|

||

|

1 |

|

|

|

||

10